Vor fünf Wochen haben wir llmocheck.ch live geschaltet – ein kostenloses Tool, das Websites auf ihre Sichtbarkeit in KI-gestützten Suchen prüft. 245 Checks später haben wir ein klares Bild: Die meisten Websites sind für das KI-Zeitalter schlicht nicht vorbereitet.

Was ist LLMO – und warum ist es relevant?

LLMO steht für Large Language Model Optimization – das Pendant zu SEO, aber für KI-Systeme wie ChatGPT, Claude, Perplexity oder Google AI Overviews. Während SEO entscheidet, ob eine Website in der Google-Suche erscheint, bestimmt LLMO, ob ein KI-System eine Website als Quelle kennt, versteht und zitiert.

Der Unterschied ist fundamental: KI-Systeme crawlen Websites anders als Suchmaschinen, erwarten strukturierte Informationen und reagieren stark auf technische Signale, die bei klassischem SEO kaum eine Rolle spielen.

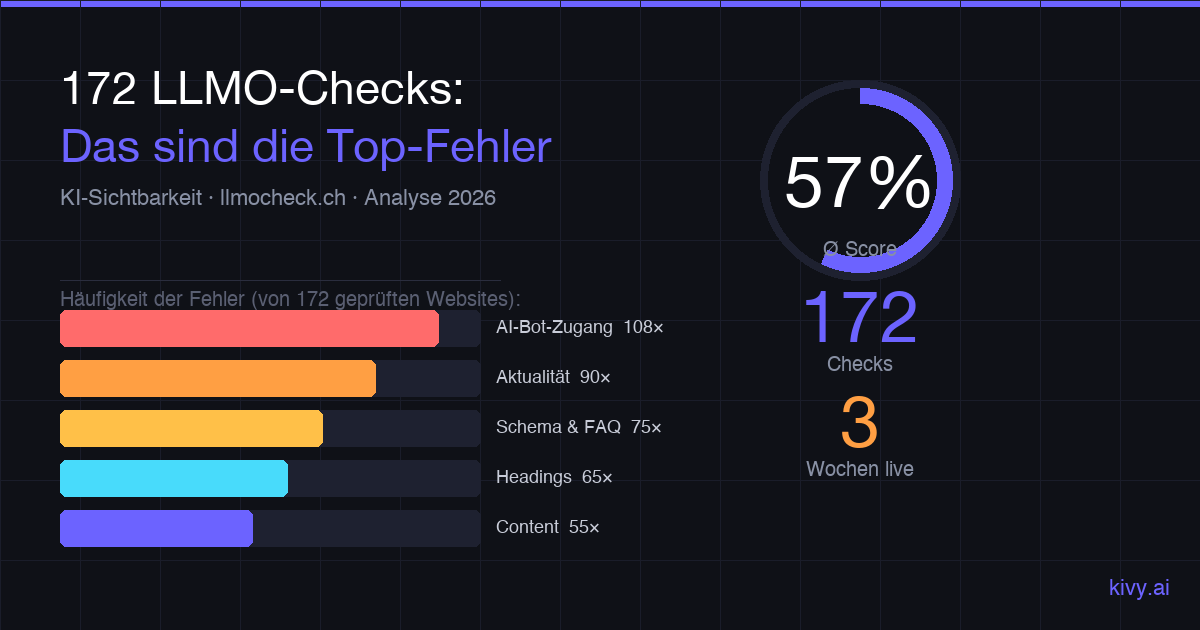

Unsere Analyse von 245 Websites zeigt: Der Durchschnittsscore liegt bei 56%. Das bedeutet, dass mehr als die Hälfte aller geprüften Websites in mindestens einem kritischen Bereich gravierende Lücken hat.

Die 5 häufigsten LLMO-Fehler

1. AI-Bot-Zugang: KI-Crawler meist unvollständig konfiguriert

Betroffen: 93% der geprüften Websites

Die gute Nachricht zuerst: Vollständige Sperren sind seltener geworden – nur noch 10% der Websites blockieren KI-Crawler hart. Die schlechte Nachricht: 83% haben eine unvollständige oder fehlerhafte Konfiguration. Das Bewusstsein für KI-Crawler wächst, die Umsetzung hinkt hinterher.

Typisches Muster: Eine robots.txt, die bestimmte Bots wie GPTBot (OpenAI) oder PerplexityBot explizit erlaubt, aber ClaudeBot (Anthropic) vergisst – oder umgekehrt. Oder eine Wildcard-Regel, die alle Bots blockiert, mit manuellen Ausnahmen für einzelne Suchmaschinen, aber ohne KI-spezifische Freigaben.

Was das bedeutet: Auch eine teilweise gesperrte Website verliert KI-Sichtbarkeit – nicht vollständig, aber systematisch. Der Crawler, den man vergessen hat, zitiert einen nicht.

Was zu tun ist: Robots.txt nicht nur auf Google & Bing prüfen, sondern explizit für GPTBot, ClaudeBot, PerplexityBot, Applebot-Extended und Gemini-Crawler konfigurieren.

2. llms.txt fehlt fast überall

Betroffen: 86% der geprüften Websites

llms.txt ist ein neues, einfaches Dateiformat – vergleichbar mit sitemap.xml, aber für KI-Systeme. Die Datei liegt im Root-Verzeichnis einer Website und erklärt KI-Modellen auf strukturierte Weise, wer das Unternehmen ist, was die wichtigsten Inhalte sind und wie Informationen zu interpretieren sind.

Ein kleines positives Signal: Gegenüber unseren ersten Wochen hat sich der Wert leicht verbessert – von über 95% auf jetzt 86%. Das zeigt, dass das Thema langsam in der Praxis ankommt. Aber 86% sind noch immer eine klare Mehrheit.

Was das bedeutet: KI-Systeme müssen die Website ohne Kontext interpretieren – und verlassen sich auf eigene Schlussfolgerungen, die oft unvollständig oder falsch sind.

Was zu tun ist: Eine llms.txt erstellen ist technisch trivial – 30 Minuten Aufwand für einen dauerhaften Vorteil.

3. Aktualität: Der unterschätzte Faktor

Betroffen: 83% der geprüften Websites

Das ist der Wert, der uns in dieser Auswertung am meisten auffällt. Aktualität ist mit Abstand der am häufigsten problematische Bereich – und gleichzeitig derjenige, der am wenigsten als LLMO-Thema wahrgenommen wird.

KI-Systeme bewerten Aktualität anders als Google. Während ein gutes Backlink-Profil bei Google auch alte Inhalte gut ranken lässt, bevorzugen KI-Modelle nachweislich aktuellere Quellen – besonders bei Themen, bei denen Aktualität eine Rolle spielt (Preise, Öffnungszeiten, Services, Angebote). Viele Websites publizieren seit Monaten oder Jahren keine neuen Inhalte mehr, haben Blog-Posts aus 2019 ohne Update-Datum und zeigen KI-Systemen damit: Diese Quelle ist möglicherweise überholt.

Was das bedeutet: Selbst inhaltlich korrekte Websites verlieren an Gewichtung, wenn die Signale auf Aktualität schwach sind.

Was zu tun ist: Regelmässige Updates, sichtbare Publikationsdaten und Meta-Informationen zur Aktualität.

4. Strukturierte Daten und Schema.org fehlen

Betroffen: ~58% der Websites (fail oder warning)

Schema.org-Markup hilft KI-Systemen, Inhalte semantisch zu verstehen: Was ist ein Produkt? Was ist eine Person? Was ist eine FAQ? Ohne strukturierte Daten ist eine Website für KI-Modelle ein unstrukturierter Textblock – interpretierbar, aber aufwändig.

FAQ-Markup ist dabei besonders wertvoll: Es macht Fragen und Antworten direkt als solche erkennbar und erhöht die Wahrscheinlichkeit, als Quelle für direkte KI-Antworten zu dienen.

Was das bedeutet: Websites ohne Schema-Markup werden von KI-Systemen schlechter eingeordnet – und seltener direkt zitiert.

Was zu tun ist: Mindestens Organization-Schema, FAQ-Markup auf relevanten Seiten und strukturierte Produktdaten implementieren.

5. Überschriften-Hierarchie: Semantik fehlt

Betroffen: ~61% der Websites (fail oder warning)

KI-Systeme nutzen die H1-H6-Struktur einer Seite, um Inhalte zu segmentieren und zu priorisieren. Viele Websites verwenden Überschriften als rein visuelles Gestaltungsmittel – H2 weil es gross aussieht, nicht weil es inhaltlich eine Hauptsektion markiert. Fehlende H1-Tags, mehrfache H1s oder völlig flache Hierarchien führen dazu, dass KI-Modelle den Seiteninhalt nicht korrekt strukturieren können.

Was das bedeutet: Schlüsselinformationen werden von KI-Systemen möglicherweise als Nebensätze behandelt – nicht als Kerninhalte.

Was zu tun ist: Klare semantische Hierarchie einhalten: Eine H1, logisch untergeordnete H2s, Abschnitte die inhaltliche Einheiten bilden.

Was gut funktioniert – und was das zeigt

Nicht alles ist schlecht. HTTPS ist nahezu universell implementiert – 99% der geprüften Websites erfüllen dieses Grundkriterium. Ähnliches gilt für Bilder-Alt-Texte bei einem Teil der Sites, was zeigt: Wo technische Standards seit Jahren kommuniziert werden, setzen sich Websites durch.

Das ist auch die eigentliche Botschaft: Die Fehler, die wir in 245 Checks gefunden haben, sind keine technischen Mysterien. Sie sind das Resultat davon, dass LLMO noch kein etabliertes Thema ist. Wer heute handelt, hat einen echten Vorsprung.

Interessant: Die einzigen Websites mit 100% in unserem Check sind kivy.ai und einige wenige Sites, die aktiv an ihrer KI-Sichtbarkeit arbeiten – unter anderem KIVY-Kundenseiten, die wir im Rahmen unserer Projekte optimiert haben.

Was ist ein guter LLMO-Score?

Hier eine grobe Orientierung basierend auf unseren Daten:

- 90–100% – Sehr gut. Website ist für KI-Systeme optimal lesbar. (Selten – rund 4% der geprüften Sites)

- 70–89% – Gut. Kleinere Lücken, aber solide Basis. Typisch für professionell betreute Websites (~30%).

- 50–69% – Ausbaufähig. Mehrere relevante Punkte fehlen. Handlungsbedarf in 1–2 Bereichen (~30%).

- <50% – Handlungsbedarf. Grundlegende LLMO-Voraussetzungen nicht erfüllt. (~37% der geprüften Sites)

Der Durchschnitt von 56% bedeutet: Die meisten Websites liegen gerade so in der Kategorie “machbar” – aber ohne gezieltes Zutun werden sie von KI-Systemen als Quellen systematisch benachteiligt.

Was bedeutet das für meine Website?

Drei Fragen, die jede Organisation stellen sollte:

Ist mein robots.txt KI-freundlich? Nicht nur für Google, sondern explizit für die wichtigsten KI-Crawler konfiguriert?

Habe ich eine llms.txt? Dieses Minimalformat ist in 30 Minuten erstellt – und wirkt sofort.

Sind meine Kernseiten aktuell? Nicht nur neu, sondern als aktuell erkennbar: mit Datum, frischen Inhalten und klaren Update-Signalen.

Fazit: Das KI-Zeitalter erfordert neue Standards

LLMO ist kein Trend, der sich wieder verflüchtigt. KI-gestützte Suche ist bereits heute für viele Zielgruppen der erste Anlaufpunkt – und der Anteil wächst schnell. Websites, die jetzt die Grundlagen legen, werden in einem Jahr einen deutlichen Vorteil haben gegenüber jenen, die auf die nächste Google-Update-Welle warten.

Unsere 245 Checks in fünf Wochen zeigen: Es gibt einen echten Bedarf. Und die Lücke ist für die meisten Websites mit überschaubarem Aufwand schliessbar.

Kostenlosen LLMO-Check machen → llmocheck.ch

Oder direkt sprechen, wenn Sie LLMO als Teil einer grösseren Website-Optimierung angehen möchten – KIVY kontaktieren.